explorer: Exploration of Unknown Environments for Digital Twins

ERC Advanced Grant

Funding ID: 101097259

Dans le projet « explorer », nous développerons

des méthodes pour capturer et étiqueter automatiquement les données vidéo dans

des « mondes ouverts ». Le but final est de faciliter grandement la création et

la maintenance de Digital Twins : les Digital

Twins sont des copies virtuelles en 3D de scènes

complexes telles que des villes, des usines ou des chantiers de construction.

Pas juste une reconstruction 3D, ils doivent capturer la sémantique de la

scène, c’est-à-dire l’identité de chaque objet et la dynamique de la scène,

c’est-à-dire la façon dont les objets se déplacent. Parce que les jumeaux

numériques ont le potentiel d’être extrêmement utiles pour surveiller de grands

sites complexes et planifier le développement de ces sites, leur marché prévisionnel

est énorme, ils restent principalement un concept en raison des limitations

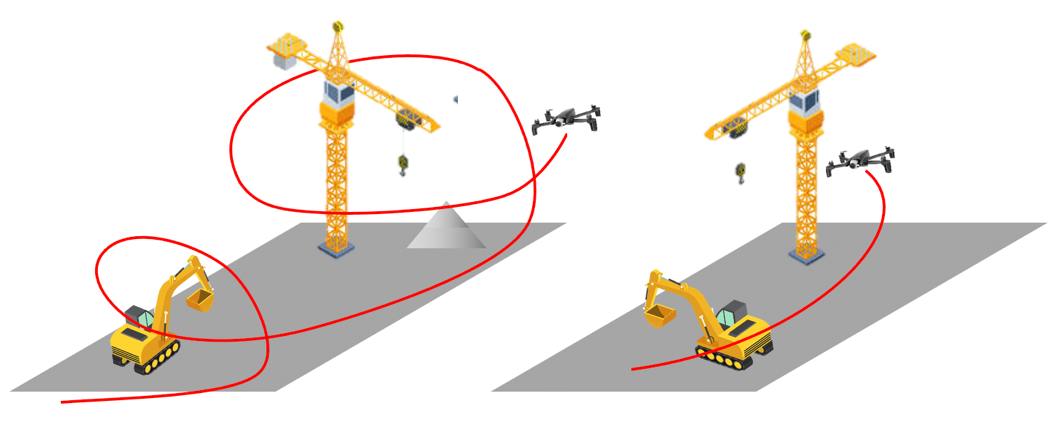

importantes de la technologie actuelle. Nos méthodes guideront les systèmes

autonomes tels que les plates-formes robotiques et les drones à travers des

environnements complexes et inconnus afin de capturer des données visuelles

pour créer et maintenir des jumeaux numériques. Ceci est extrêmement difficile

car ces systèmes rencontreront des objets sans aucune connaissance préalable à

leur sujet et devront collecter suffisamment de données à leur sujet. A notre

connaissance, cette capture active et automatique dans des environnements réels

complexes constitue une problématique nouvelle. Il est cependant très important

de le résoudre car cela réduirait le besoin d’expertise humaine et de temps :

actuellement, la capture de ces données est effectuée manuellement uniquement

par les chercheurs et nécessite une solide compréhension de ce qu’exigent les

algorithmes d’apprentissage.

Pour aborder la complexité de ce problème, notre

approche s’inspire des techniques de l’Intelligence Artificielle appliquées à

l’exploration d’arbres de très grande taille. Cette approche nous permettra de

réunir la partie perception et la partie planification du problème sous un même

cadre d'optimisation, de le formaliser et de le résoudre efficacement. Pour

évaluer nos développements, nous développons un simulateur de scènes complexes

de sites de travail, que nous partagerons avec la communauté.

Membres : Vincent Lepetit, David

Picard (chercheur), Pascal Monasse (chercheur), Clémentin

Boittiaux (ingénieur de recherche),

Arslan Artykov (doctorant),

Shiyao Li (doctorant)

Articles liés (ayant motivé le projet) :

HOC-Search: Efficient CAD Model and

Pose Retrieval from RGB-D Scans. Stefan Ainetter, Sinisa Stekovic,

Friedrich Fraundorfer, and Vincent Lepetit. In International Conference

on 3D Vision, 2024.

MACARONS: Mapping And Coverage

Anticipation with RGB ONline Self-supervision. Antoine Guédon, Tom

Monnier, Pascal Monasse, and Vincent Lepetit. In Proceedings of the

IEEE Conference on Computer Vision and Pattern Recognition (CVPR), 2023.

Automatically

Annotating Indoor Images with CAD Models via RGB-D Scans. Stefan

Ainetter, Sinisa Stekovic, Friedrich Fraundorfer, and Vincent Lepetit. In IEEE

Winter Conference on Applications of Computer Vision (WACV), 2023.

SCONE: Surface Coverage

Optimization in Unknown Environments by Volumetric Integration. Antoine

Guédon, Pascal Monasse, and Vincent Lepetit. In Advances in Neural

Information Processing Systems (NeurIPS), 2022. Spotlight

MCTS with Refinement for

Proposals Selection Games in Scene Understanding. Sinisa Stekovic,

Mahdi Rad, Alireza Moradi, Friedrich Fraundorfer, and Vincent Lepetit. IEEE

Transactions on Pattern Analysis and Machine Intelligence (PAMI), 2022.

MonteBoxFinder: Detecting and

Filtering Primitives to Fit a Noisy Point Cloud. Michael

Ramamonjisoa, Sinisa Stekovic, and Vincent Lepetit. In Proceedings of

the European Conference on Computer Vision (ECCV), 2022.